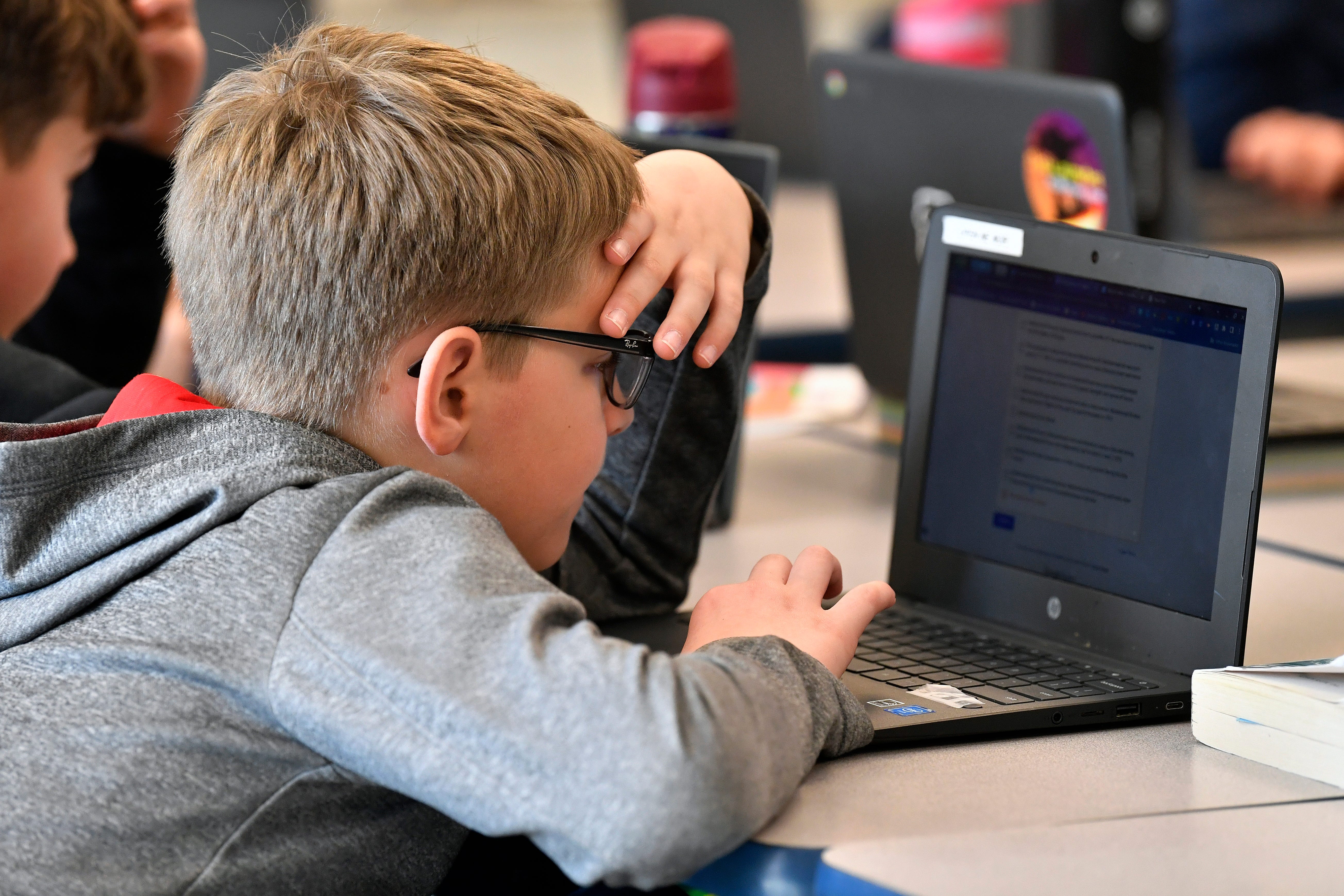

ケンタッキー州の 5 年生がテクノロジーの使い方を学ぶために ChatGPT を採用

ChatGPT は、学生が AI 搭載のチャットボットを使用してエッセイを書き、宿題をカンニングするのではないかという懸念を表明しています。 しかし、生徒が将来必要とするツールになりつつあると言う教師もいます。 (2 月 14 日) (AP ビデオ: Dylan Louvain)

AP

即座に生成されたわかりやすい回答で人々の質問に答えるChatGPTの驚くべき能力は、医学的アドバイスを求める人々にとってゲームチェンジャーになる可能性がありますが、新しい医学雑誌の記事によると、それはそれほど単純ではありません. ChatGPTもそうです。

マイクロソフトのコーポレート バイス プレジデントであるピーター リー (Peter Lee) は、この 6 か月間、ChatGPT の最新バージョンを試してきました。ChatGPT は、ユーザーの質問に会話形式で答えるように設計された人工知能プラットフォームです。

他のいわゆる大規模言語パラダイムと同様に、サンフランシスコのスタートアップ OpenAI によって作成された ChatGPT は、インターネット、本、およびその他のソースで入手可能な膨大な量のデータでトレーニングされています。 アルゴリズムを使用して、インターネット上で一緒に出現する頻度に基づいて一連の単語を生成します。 Microsoft の Bing 検索エンジンは ChatGPT を使用するようになりました。

世界中でマイクロソフトの研究を行っているコンピューター科学者のリーは、ChatGPT の医学的および科学的可能性に特に関心を持っています。

以前: ChatGPT は、医療情報を覆す態勢を整えています。 良くも悪くも。

彼 木曜日にニューイングランド・ジャーナル・オブ・メディスンに記事が掲載されました 医療メモの記録、診断機能の提供、臨床医と患者の教育、データの分析と要約のための ChatGPT の潜在的な用途について。 特に注目に値するのは、人間のような共感的な反応を提供するインターフェイスの能力です。

ChatGPT の最新バージョンである ChatGPT-4 について、近刊予定の書籍「The AI Revolution in Medicine: GPT-4 and Beyond」の共著者でもあるリーに、興奮と懸念について尋ねました。最近リリースされました。 ChatGPTでも同様の質問をしたのですが、まだ利用が制限されているため、ChatGPT-3から回答が来ています。

質問: ChatGPT は信頼できる医療情報を提供しますか?

私のため: 個人的には、個人的な健康に関するアドバイスや情報について、このレベルの洗練されたモデルを信頼していません。

チャットGPT: ChatGPT は、医療情報を含む大量のテキスト データでトレーニングされた言語モデルです。 ただし、ChatGPT は医療専門家ではなく、その回答は医学的アドバイスと見なされるべきではないことに注意することが重要です。

ChatGPT は医療トピックに関する情報を提供する場合がありますが、健康に関する決定を下す前に、資格のある医療専門家にその情報を確認することが不可欠です。 また、ChatGPT が不正確または古い医療情報を提供するリスクもあり、これは有害な可能性があります。

質問: ChatGPT が作成するエラーの種類とその理由は何ですか?

私のため: 一般に、GPT フォームは情報の取得が非常に苦手です。 GPT モデルはトレーニング データを再コンパイルしたくないため、ほとんど設計によるものです。 論文への参照など、特定のソースを求めている場合、彼は正確なソースを生き生きとさせることができないため、彼は何かをでっち上げ、「幻覚」を起こしています。

チャットGPT: ChatGPT は、不適切または不正確な応答を提供したり、自分自身を繰り返したり、会話のコンテキストに一致しない応答を生成したりするなどのエラーを起こす可能性があります。

これらのエラーが発生するのは、ChatGPT が未検証の潜在的に偏った情報を含む膨大な量のテキスト データでトレーニングされているためです。これにより、誤った情報や古い情報が生じる可能性があります。

さらに、ChatGPT の応答は、受信する入力の品質の影響を受ける可能性があり、その結果、無関係またはトピックから外れた応答になる可能性があります。

質問: ChatGPT-4 は ChatGPT-3 より優れている点は何ですか?

私のため: 私たちは異なるレベルの知性に到達します。 主なことは、多くの認知機能を備えたこの AI モデルと、チャット インターフェイスがあることです。 やり取りするのが本当に自然になります。

チャットGPT: スケール、精度、多言語機能、コンテキストの理解、一貫性などの分野で改善が期待されるのは当然です。

質問: ChatGPT が実在の人物のように見えることがあります。 ChatGPT には、他人の精神状態を想像する能力である「心の理論」がありますか?

私のため: これはできません。 機械です。 しかし、GPT-4 に、(特定の状況で) 患者が何を考え、何を感じているかを尋ねることができます。 彼はその心の状態を評価することができます。 … それは患者への共感につながります。

チャットGPT: いいえ、ChatGPT には心の理論がありません。

ChatGPT は、統計パターンとアルゴリズムを使用して自然言語入力に対する応答を生成する機械学習モデルです。 意識、感情、信念はなく、人間のユーザーの精神状態を理解したり推測したりする能力もありません。

ChatGPT は、共感的で、魅力的で、会話的な応答を生成できますが、人間の認知と社会的相互作用の重要な側面である心の理論を持っていません。

質問: ChatGPT を医療に使用する必要がありますか?

私のため: 社会には選択肢があります。 リスクを完全に理解していないため、このテクノロジーの速度を落としたり、オフにしたりすることができます。 2 番目の議論はより宿命論的で、「彼は止められない。試してみたほうがいい」と言っています。 3 番目のオプションは、唯一合理的なものだと思いますが、意図的に行う必要があります。人間だけでも AI だけでもできないことを達成できるように、このテクノロジーを生活にどのように統合できるかを慎重に検討することです。 . 医療界と一般市民が 3 番目の選択肢を選択することを願っています。

チャットGPT: ChatGPT は、医学的なアドバイスや診断のみを目的として使用するべきではありません。 ChatGPT は医療トピックに関する情報を提供できる場合がありますが、ChatGPT は医療専門家ではなく、その応答は情報提供のみと見なされるべきです。

ただし、ChatGPT は、医療の概念と用語の一般的な理解を得るための便利なツールです。 いずれにせよ、ChatGPT が提供する情報は資格のある医療専門家に確認して、その情報が正確であり、あなたの状況に適用できることを確認することが不可欠です。

kweintraub@usatoday.com で Karen Weintraub に連絡してください。

USA TODAY の健康と患者の安全に関する報道は、Masimo Foundation for Ethics, Innovation, and Competition in Health Care からの助成金によって部分的に可能になっています。 マシモ財団は、編集上の意見を提供していません。

「主催者。ポップカルチャー愛好家。熱心なゾンビ学者。旅行の専門家。フリーランスのウェブの第一人者。」

/cdn.vox-cdn.com/uploads/chorus_asset/file/25592468/2113290621.jpg)

More Stories

ゼネラルモーターズとサムスン、インディアナ州に35億ドルをかけて電気自動車用バッテリー工場を建設することで合意

Nvidia のカウントダウンが始まると株価が上昇: マーケットラップ

AT&T の顧客は数時間にわたるワイヤレス サービスの停止を報告しています